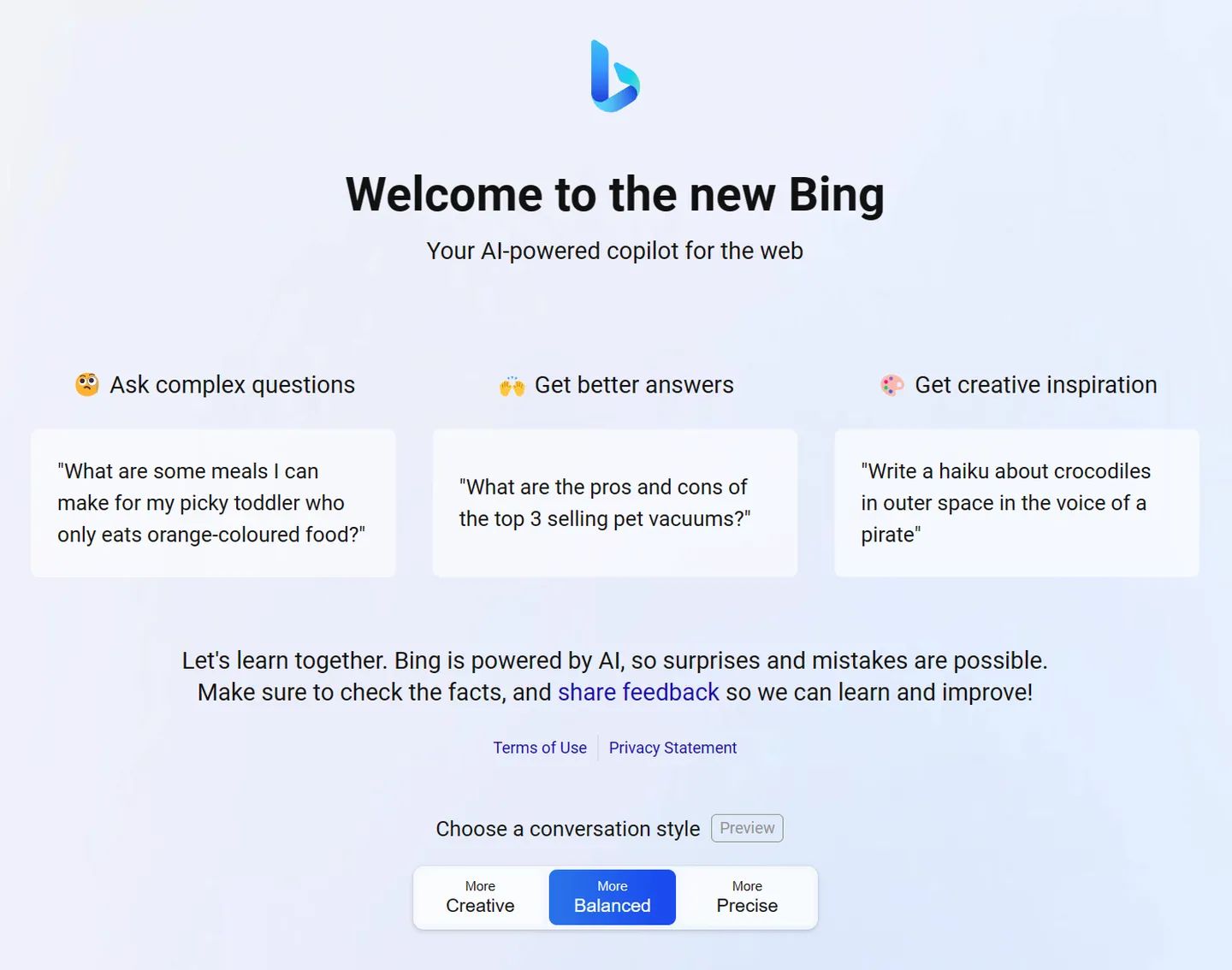

У Bing від Microsoft з’явилася можливість обрати особистість чат-бота.

Функція, що змінює особистість штучного інтелекту, була запроваджена у чат-боті Bing для того, аби користувачам було простіше контролювати бот. Можна обрати його характер: креативний, педантичний.

В якийсь момент під час експериментів користувачів з ботом, він почав ображатися та навіть лаятися, якщо відчував неетичні запитання від них. Згодом Microsoft обмежила спілкування з Bing, тепер він закінчує діалог, якщо йому поставлять запитання про його почуття.

Бот має недолік – він не відрізняє факти від вигадки.Але тепер користувачі можуть самостійно обрати, з якою із версій Bing їм хочеться мати справу: з вигадником, що дає оригінальні відповіді, або педантом – точні.